CPU,大模型的另一種解法

金磊 明敏 發自 凹非寺

量子位 | 公衆號 QbitAI

當大模型踏入醫療行業與人類醫生一較高下時,它能達到什麼水平?

就在最近,醫學頂刊BMJ便給出了這樣一個結論:

在遵循公認的臨牀抑鬱症治療標準方面,

先進大模型可能比醫生要強

!

從研究結果上來看,大語言模型(LLM)在輕度和重度抑鬱症治療方面,已經達到了公認的治療標準。

不僅如此,它們還不會被患者的外在因素所影響(包括性別、社會階層等等),這就比人類初級醫生還要強上一點了。

這是否就意味着類LLM選手們現在可以“持證上崗”了呢?

非也,非也。

考慮到抑鬱症治療的持續性和患者病情的多樣性,這項研究認爲,真正的治療過程還是需要人類醫生來進行。

不過研究同樣指出,LLM對於現階段醫療可以起到

輔助決策

的幫助:

有可能加強初級衛生保健的決策,提高精神衛生服務的質量和公正性。

畢竟自從LLM熱潮以來,包括谷歌在內的衆多AI玩家,都致力於推動其在醫學領域中的作用。

甚至像“男孩閱醫無數,最後竟被AI成功診出病因”這樣的新聞也是頻頻被曝出。

那麼問題來了——LLM在現實中的醫療領域,到底走到了哪一步?

LLM,已然深扎醫療

一直以來,醫療行業都被視爲AI落地的重要領域。

在深度學習浪潮剛剛興起之時,深度學習三巨頭之一Hinton就說出了名言:

5年內AI可以取代放射科醫生。

儘管這個表達有些激進,但它揭露了一個事實,至少在科研層面,AI和醫療的結合是非常被看好的。

在過去一段時間以來,AI醫療場景不斷開拓,比如利用CV算法識別病竈、檢測心電圖等。科技巨頭們都緊跟趨勢,如微軟、谷歌、IBM等都在持續投入資金,推進AI醫療落地。

尤其在ChatGPT趨勢到來以後

,LLM更強的學習能力、更好的遷移能力以及更深的理解能力,都爲AI醫療落地打開新局面。

而且這會是一個很確定的趨勢,因爲技術、應用落地和行業發展都準備好了。

首先技術方面

,今年是大模型爆發的一年,目前國內已經形成“百模大戰”格局。

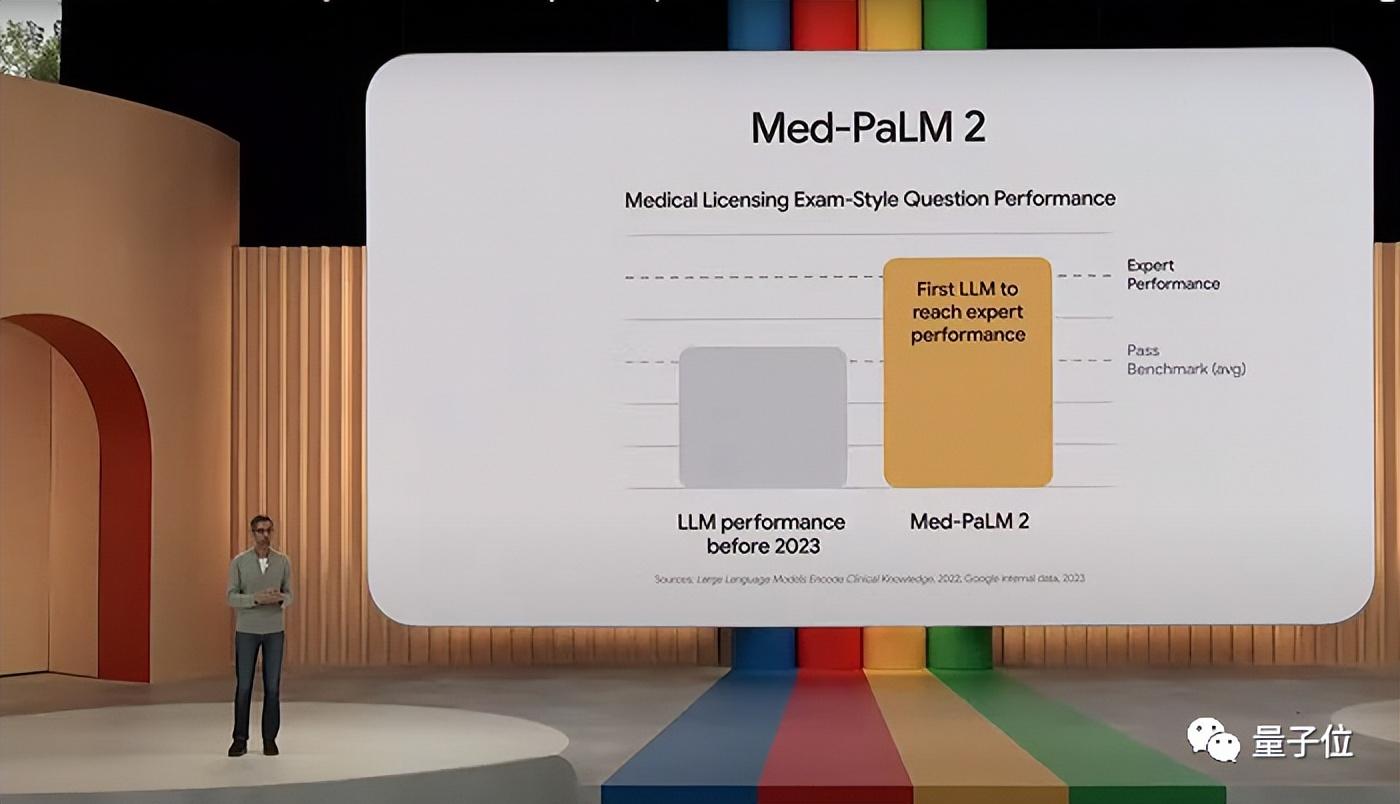

諸多大模型廠商都主打To B路線,正在加速推動大模型在各個行業的應用。還有一些廠商直接推出面向醫療的行業大模型,比如谷歌推出的Med-PaLM 2就已經在診所實測。

所以對於醫療領域而言,當下是不缺“模”的。

其次,大模型和醫療領域也天生非常契合

。

在常見的問診、病歷生成、患者病史分析等場景,都需要醫生基於歷史信息進行整合總結、分析判斷,這正是大模型的長項。

比如利用大模型的總結摘要能力,可以快速對多類數據進行總結並形成摘要,幫醫生完成繁瑣、重複性高的工作,提升效率。

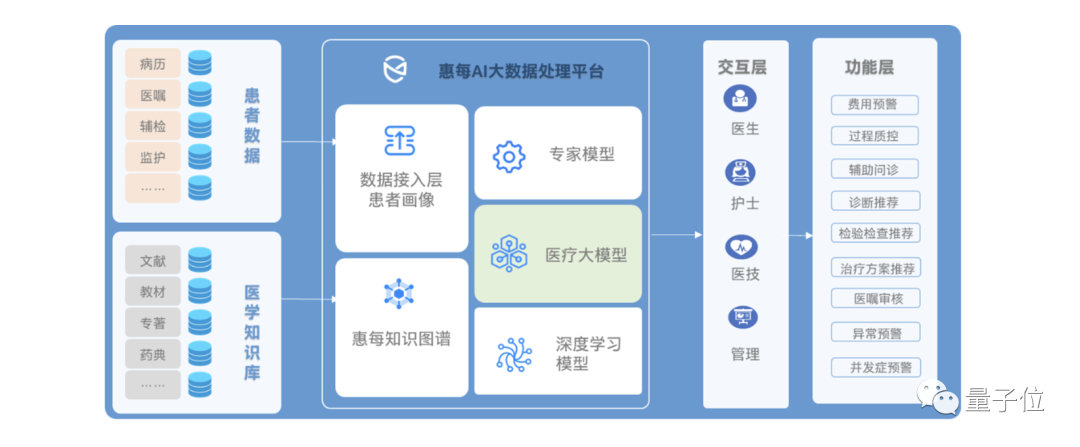

並且實際落地上,只需以基座大模型爲底,應用專業醫療數據訓練,就能得到一個強大的醫療大模型,這能從根本上加速AI醫療落地。還能在一個系統中集成多個子模型,即可快速覆蓋更多場景。

再來看行業發展方面

,以國內情況爲例,數字化醫療、AI醫療逐漸發展爲一個獨立賽道,玩家們利用

數據分析

、

自然語言處理(NLP)

、

結構化數據

等技術,已經成功將AI引入臨牀診斷決策、病例數據管理等。

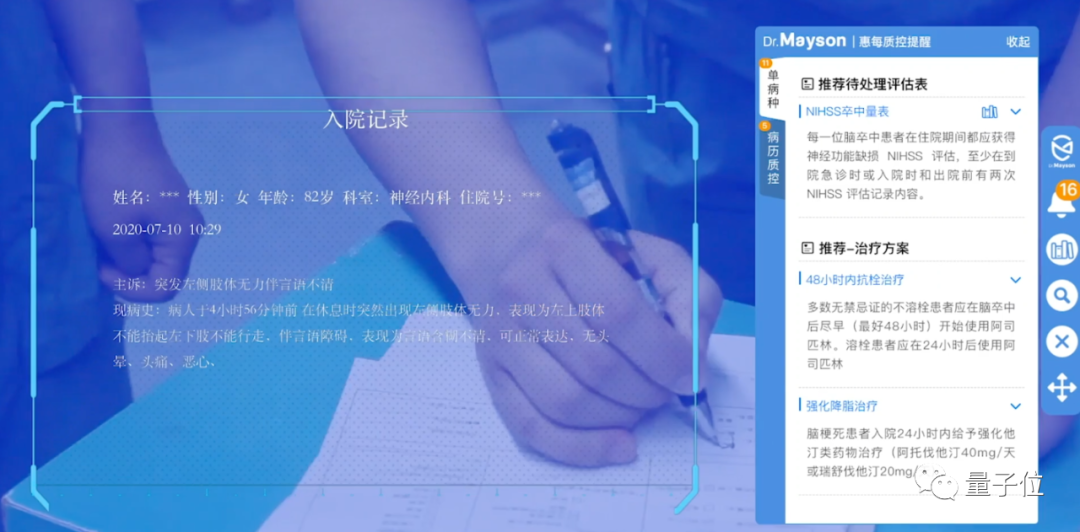

如惠每科技開發的面向醫院的

核心應用Dr.Mayson

。

簡單理解,這是一個能優化醫院看診、決策、預警、管理等方面的智能應用,核心目標就是讓醫院數字化系統運行更加絲滑流暢,提高醫生診療效率。

它主要融入了

PDCA過程管理和CDSS(臨牀決策支持系統)

。利用機器學習、深度學習、大數據挖掘等技術,可以智能識別分析病歷文書、LIS/RIS報告等患者完整病歷數據;爲醫院構建專門的醫學知識庫;給醫生、醫技、護士、管理方提供實時智能參考與建議。

在惠每科技最新發布的CDSS 3.0架構中,新一代AI大數據處理平臺已集成了醫療大模型,並已經在某合作醫院的病歷生成等場景中獲得了醫生的認可。

綜上,醫療大模型應用落地路徑已經比較明確。但是落地的過程卻沒有想象中的那般容易。

醫療大模型落地,怎麼解?

醫療大模型落地目前遇到的兩大核心問題,都非常具有原生性:

- 爲保證患者數據安全,醫院數據僅能內網使用

- 當前GPU算力緊張,醫院很難負擔如此高昂的採購成本

這意味着,醫療大模型需要進行私有化部署,且需要尋找一條能夠針對於提升大模型算力的“性價比”道路。

所以,AI加速成爲了近來業界備受關注的領域。它直接關乎大模型落地的效率和成本,行業內各大廠商的加速方案也都受到熱捧。

比如剛剛提到的惠每科技便攜手英特爾,在基於第四代

英特爾® 至強® 可擴展處理器

的基礎設施上,打造了量化和非量化兩種

大模型推理加速方案

。

如何實現?

先來看量化部分,也就是通過降低模型精度來實現加速。

以FP32量化到INT8爲例,它能讓GPU或CPU適應更快、更低成本的8位張量來計算卷積和矩陣乘法,可有效提高計算吞吐量。還能減少模型數據搬運所需的時間和資源,這是數據從內存移動到計算單元的必然消耗,精度從32位降低到8位,能實現4倍減少量。

同時量化也能減少內存的使用,讓模型需要更少的存儲空間、參數更小、緩存利用率更高。

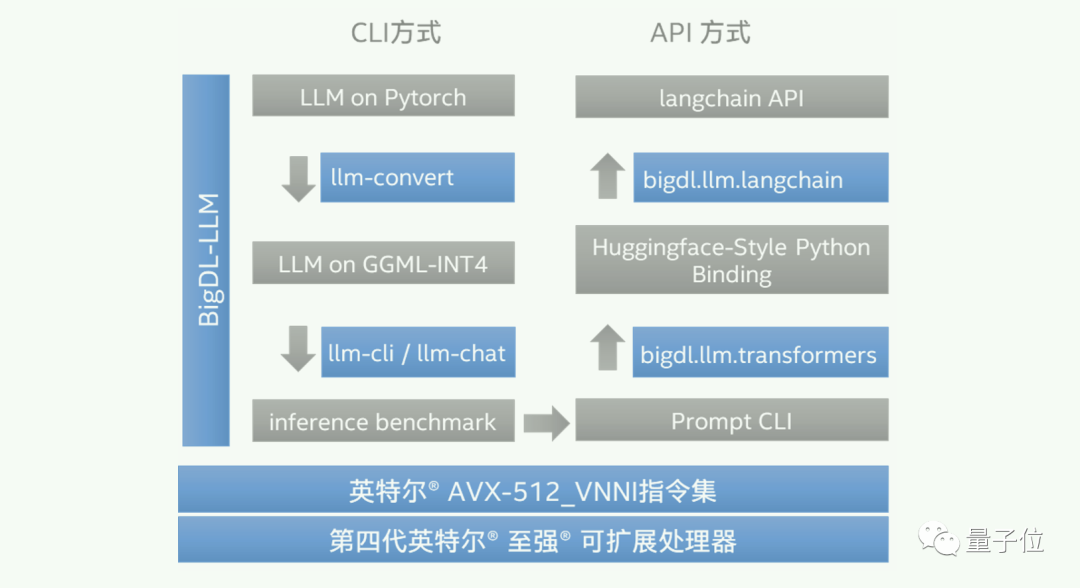

具體實現方案上,惠每科技引入了英特爾開發和開源的BigDL-LLM大語言模型加速庫,其提供對各種低精度數據格式的支持與優化,同時配合不同型號和代際的英特爾處理器內置指令集(如英特爾® AVX-512_VNNI、英特爾® AMX等)在大模型應用中可以實現較優推理加速。

使用方面,此方案提供了便捷命令和編程接口兩種方法,能方便預覽量化後模型性能是否符合預期;另外在性能達標的情況下,憑藉BigDL-LLM提供的HuggingFace API/Langchain API,用戶可以輕鬆將優化性能整合到部署推理服務中去。

△BigDL-LLM爲醫療大模型提供推理加速

對於非量化技術路徑,英特爾也能提供鍵值(KV)緩存、算子融合的

OpenWINE™

加速方案。

KV緩存用於通過鍵值對的方式存儲數據,能加速和優化數據訪問。算子融合是將神經網絡中多個連續運算符融合成一個運算符,從而減少內存訪問、提高計算效率。

在惠每科技主要使用的開源基座大模型ChatGLM上,基於

英特爾® OpenVINO™ 工具套件打造的非量化方案

能利用零拷貝(Zero-Copy)視圖傳遞預分配的KV所需的內存副本空間,避免數據的多次拷貝,實現KV緩存加速;

也能引入第四代英特爾® 至強® 可擴展處理器內置的英特爾® AMX指令集,幫助ChatGLM等醫療大模型加速BF16/INT8計算,實現算子融合,在保證精度的前提下提升運算效率、加速推理;

同時OpenVINO™ 工具套件提供了在HuggingFace上的Optimum接口,讓優化效果可擴展到更多醫療大模型推理應用中。

總結來看,英特爾與惠每科技聯手打造的兩個大模型加速方案,成功幫助醫療機構用較低成本部署了高質量大語言模型,並且爲更多準備“入局”的同行們提供了一套完整教程。

更關鍵的是,本次合作也讓我們看到了一個事實:大模型訓練推理並非唯GPU一種解法,CPU也可以作爲大模型在行業落地的平臺。

CPU,大模型的另一種解法

或許很多人一提到大模型,刻板印象往往會是“堆GPU”。

但事實上,英特爾在通過自身的實踐在證明——CPU,亦是一種解法。

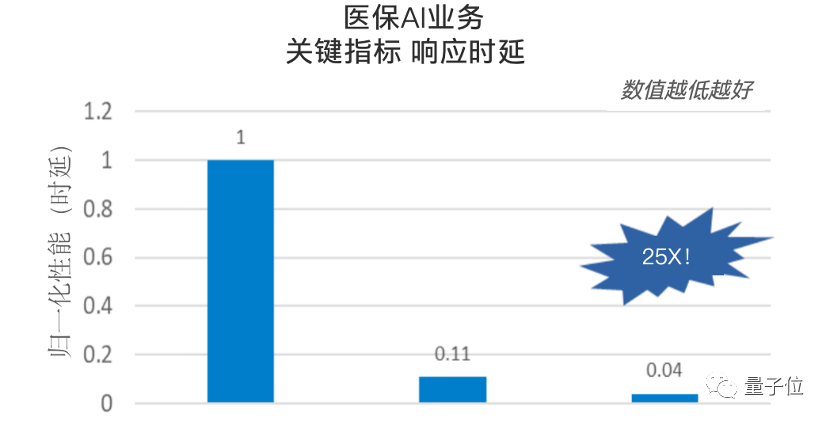

例如在我們耳熟能詳且經典的OCR(光學字符識別)領域,在英特爾第四代至強® ️可擴展處理器的加持之下,響應延時指標在原有基礎上足足提升達25倍!

△數據來源:英特爾合作伙伴

再比如媒體娛樂場景中,尤其在AMX加速引擎加持下,英特爾能幫助個性化內容推薦速度提升達6.3倍;零售行業裏,能將視頻分析速度提升高達2.3倍,還有像工業缺陷檢測、醫療服務也都能從容應對。

即便是在生命科學和醫藥等前沿探索領域,CPU也已經成爲不容忽視的存在:甚至在某些場景下的表現效果比GPU還要好。

而這些案例,也只是英特爾CPU在大模型時代表現中的一隅;更重要的應當是英特爾在過去一段時間和未來,所堅持的 “走法”:不僅重視硬件產品性能的提升,對於軟件優化和打造生態系統同樣付出大量心血,給用戶提供全流程支持。

這也是爲什麼在今年的Intel Innovation 2023上,英特爾敢於喊出“AI everywhere(讓AI無處不在)”的口號;爲什麼在12月中旬即將發佈的新一代至強® 可擴展處理器、產品和加速方案,充斥着“AI”和“大模型”的味道。

總而言之,CPU巨頭英特爾,在大模型時代之下確實在開闢着與衆不同的路數。

至於新一代至強® 可擴展處理器和其他產品又會給大模型帶來怎樣的性能提高,也是值得期待一波的。

如若转载,请注明出处:https://www.tuio.cc/383.html