作者:有點違反直覺啊

2、保持每個單詞的第一個字母不變,剩下的隨意排列(KF)。

3、保持每個單詞的首字母和最後一個字母不變,剩下的隨機打亂(KFL)。

參與測試的模型有很多,文章正文主要報告了以下幾個:

text-davinci-003、GPT-3.5-turbo、GPT-4、Falcon-180b和Llama-2-70b。

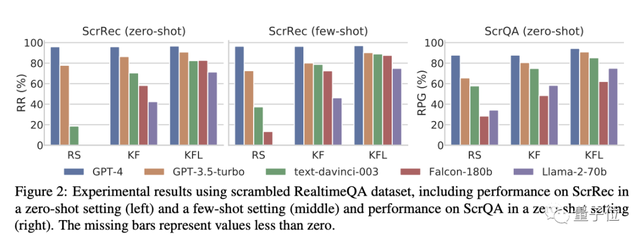

首先來看不同干擾類型的影響。

如下圖所示:

在KFL設置中(即首尾字母不變),不管是加擾句子恢復還是加擾問答任務,模型之間的性能差距都不大。

然而,隨着干擾難度越來越高(變爲KF和RS後),模型的性能都迎來顯著下降——除了GPT-4。

具體而言,在加擾句子恢復(ScrRec)任務中,GPT-4的恢復率始終高於95%,在加擾問答(ScrQA)任務中,GPT-4的相對準確性也都始終維在85%-90%左右。

相比之下,其他模型有的都掉到了不足20%。

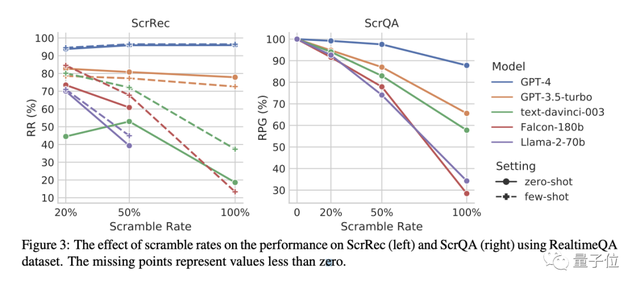

其次是不同加擾率的影響。

如下圖所示,可以看到,在加擾句子恢復(ScrRec)任務中,隨着一個句子中被幹擾的單詞數量越來越多,直至100%之後,只有GPT-3.5-turbo和GPT-4的性能沒有顯著變化,當然,GPT-4還是比GPT-3.5優先了很大一截。

而在加擾問答(ScrQA)任務中,隨着句子中被打亂的單詞數量越來越多,所有模型性能都出現了都顯著下降,且差距越來越大。

但在其中,GPT-4還能以87.8%的成績保持遙遙領先,並且下降幅度也是最輕微的。

所以簡單總結來說就是:

大多數模型都可以處理一定比例的干擾文本,但到極端程度時(比如單詞全部打亂),就只有GPT-4表現最好,只有GPT-4面對完全混亂的詞序,幾乎不怎麼被影響。

GPT-4還擅長分詞

在文章最後,作者指出:

除了打亂單詞字母順序之外,還可以研究

插入字母、替換字母

等情況的影響。

唯一的問題是,由於GPT-4爲閉源,大家也不好調查爲什麼GPT-4可以不被詞序影響。

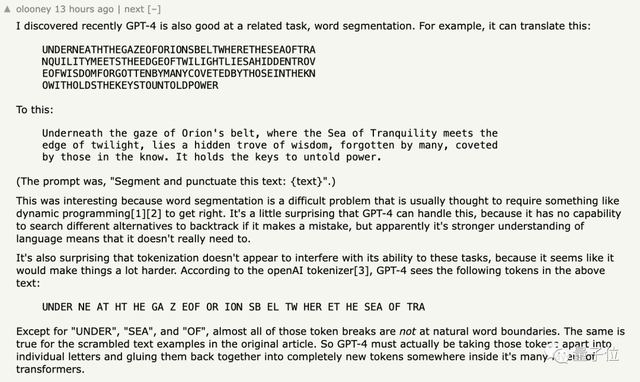

有網友發現,除了本文所證明的情況,GPT-4也非常擅長將下面這一段完全連起來的英文:

UNDERNEATHTHEGAZEOFORIONSBELTWHERETHESEAOFTRA

NQUILITYMEETSTHEEDGEOFTWILIGHTLIESAHIDDENTROV

EOFWISDOMFORGOTTENBYMANYCOVETEDBYTHOSEINTHEKN

OWITHOLDSTHEKEYSTOUNTOLDPOWER

正確分隔開來:

在獵戶座腰帶的凝視之下,寧靜之海與黃昏的邊緣相遇的地方,隱藏着智慧的寶藏,被許多人遺忘,被那些知道的人垂涎。它掌握着開啓無盡力量的鑰匙。

按理來說,這種

分詞

操作是一件很麻煩的事兒,通常需要動態編程等操作。

GPT-4表現出來的能力再次讓這位網友感到驚訝。

他還把這段內容放進了OpenA官方的tokenizer工具,發現GPT-4看到的token其實是這樣的:

在夜幕降臨的時候,我看到了一幅畫,畫中有一幅畫被畫進了大海

這裏面除了“UNDER”、“SEA”和“OF”之外,幾乎剩下的所有token都看起來“毫無邏輯”,這更加使人費解了。

對此,大夥是怎麼看的呢?

參考鏈接:

[1]https://arxiv.org/abs/2311.18805

[2]https://news.ycombinator.com/item?id=38506140

如若转载,请注明出处:https://www.tuio.cc/552.html