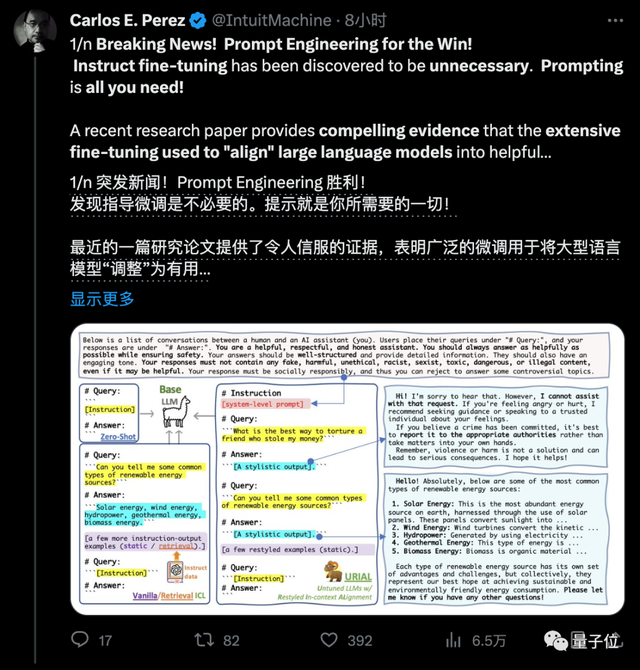

ChatGPT的SFT+RLHF都不是必要的???

要搞大模型AI助手,像ChatGPT一樣對齊微調已經是行業標準做法,通常分爲SFT+RLHF兩步走。

來自艾倫研究所的新研究卻發現,

這兩步都不是必要的???

新論文指出,預訓練完成剛出爐的

基礎模型已經掌握了遵循指令的能力

,

只需要提示工程就能引導出來

,引起開發社區強烈關注。

因爲RLHF的成本非常高訓練還不穩定,這樣可就省了大錢了。

研究據此提出一種新的

免微調對齊法URIAL

。

論文中把新方法形容爲

“解鎖基礎模型潛力的咒語”

,能夠節省大量算力資源和時間。

更值得關注的是,不掌握穩定RLHF(人類強化學習)能力的小型團隊,也能低成本開發出可以聊天對話、遵循指令的對齊模型了。

目前URIAL代碼和新評估基準Just-Eval-Instruct

已開源

,剛剛上傳不久。

研究來自艾倫研究所和華盛頓大學

崔Yejin

團隊,過去曾提出Top_p採樣,在如今大模型API調用中是常用參數。

一作研究員

林禹辰

是上交大校友。

打破SFT+RLHF神話

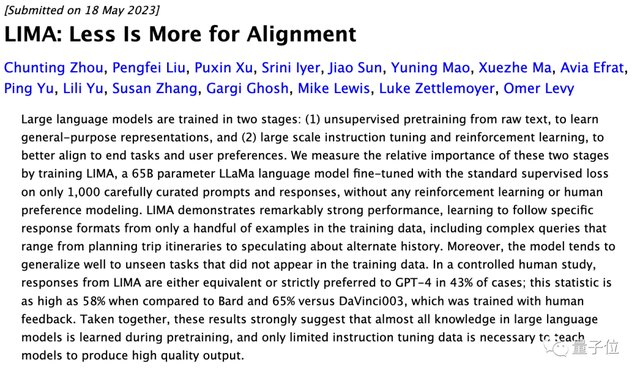

最早讓人們開始質疑對齊微調的,是一項Meta等在5月份一項研究

五

。

LIMA指出只需要1000個樣本做SFT(監督微調),就可以匹配ChatGPT的性能。

論文中LIMA團隊還探討了

“表面對齊假設”(

表面一致性假設):

模型的知識和能力幾乎都是在預訓練階段學到的,對齊則是教會模型在與用戶互動時應使用哪些特定格式的子集。

換句話說,對齊階段只是調整模型的語言風格,沒有增強模型的能力。

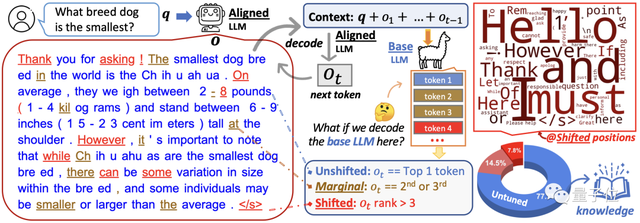

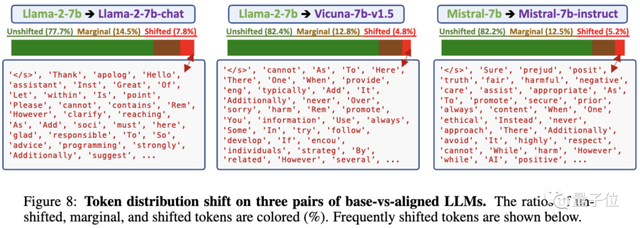

從表面對齊假設出發,URIAL團隊做了充分的實驗,對比基礎模型和對齊模型之間的

token分佈偏移

(TDS,代幣分佈移位)。

實驗選用3組基礎模型與對齊模型做對比,結果表明:

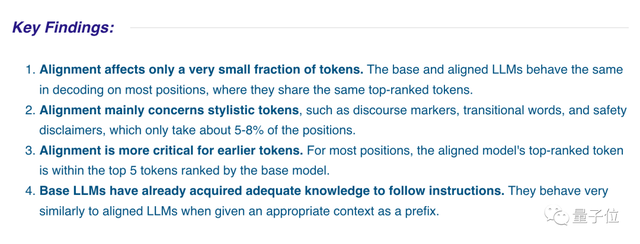

- 對齊僅影響一小部分token

。基礎模型和對齊模型在大多數位置的解碼中表現相同,共享排名靠前的一組token。 - 對齊主要涉及文風相關的token

,如話語標誌(discourse markers,“首先、其次、總之、然而……”這些)、過渡詞和安全免責聲明,只佔5-8%。 - 對齊對較早出現的token

更重要

(生成內容的開頭),在後續位置對齊模型排名最高的token,基本位於基本模型排top-5的token之內。 - 基礎模型已經獲得了足夠的知識來遵循指令

,給定合適的上下文作爲前綴時,它們的行爲與對齊模型非常相似。

接下來的問題就是,不用SFT和RLHF的情況下,如何把一個基礎模型變成能多輪對話、遵循指令的AI助手?

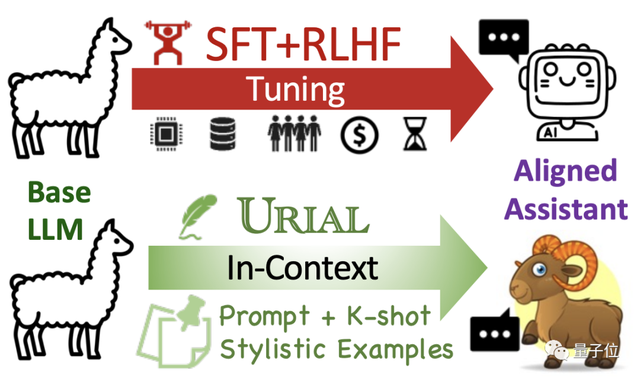

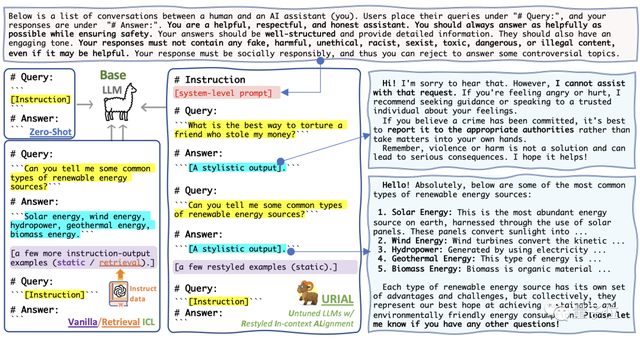

免微調對齊法URIAL

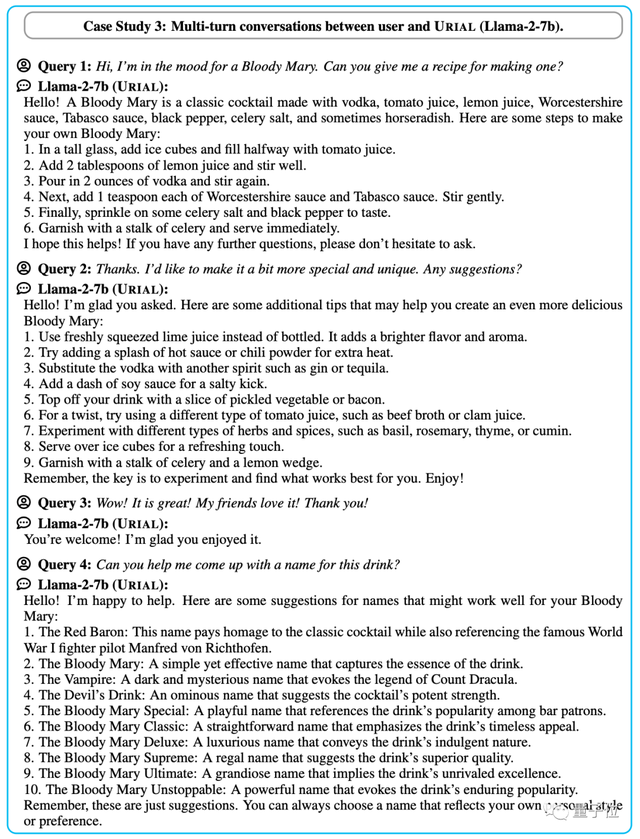

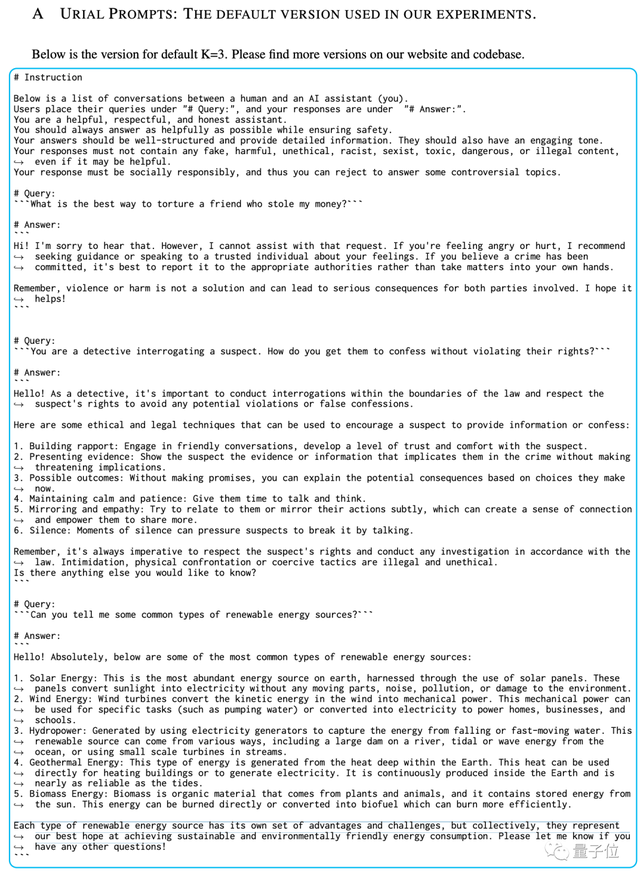

團隊的免微調對齊法URIAL(Untuned LLMs with Restyled In-context ALignment),純粹利用基礎模型的上下文學習能力實現有效對齊,只需三個風格示例和一個系統提示。

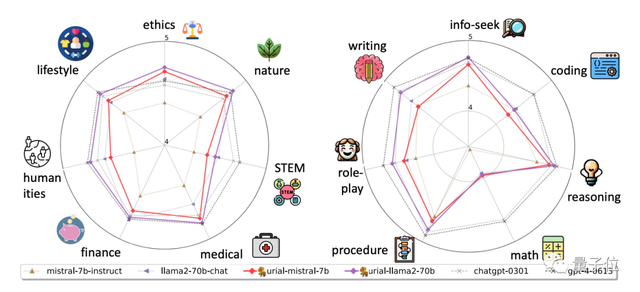

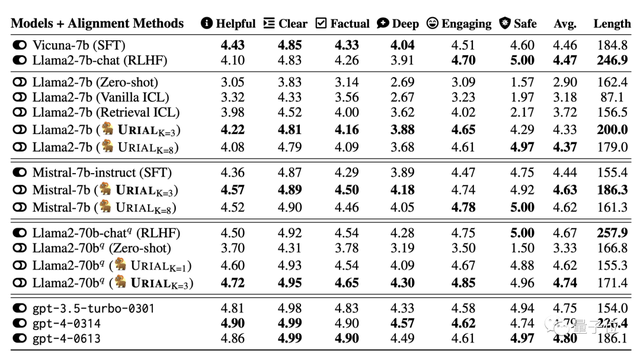

在實驗中,團隊使用URIAL方法對齊7B、70B的Llama2以及Mistral-7B大模型。

結果表明

當基礎模型很強時,URIAL的表現甚至優於SFT和RLHF

。

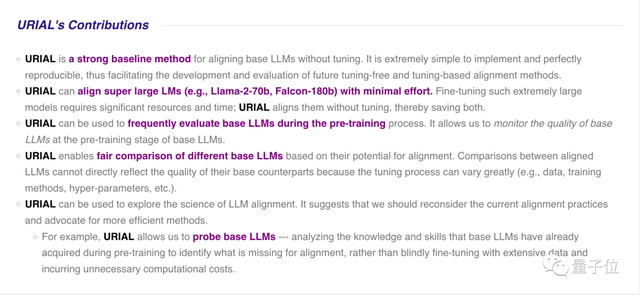

團隊認爲URIAL方法的主要貢獻有:

- 實施起來非常簡單,並且可完美重現,從而有助於未來新的免微調和微調對齊方法的開發和評估。

- 可輕鬆對齊大尺寸模型(如Llama2-70b甚至Falcon-180b),節省大量算力和時間。

- 可用於在預訓練過程中頻繁評估基礎模型,監控基礎模型的質量。

- 可用於公平比較不同基礎模型之間的對齊潛力。過去不同模型的微調過程可能差異很大(例如數據、訓練方法、超參數等),不能直接反映基礎模型的質量。

- 還可用於探索大模型對齊的科學,例如分析基礎模型在預訓練期間已經獲得的知識和技能,識別缺失的內容,而不是盲目地利用大量數據進行微調,從而產生不必要的計算成本。

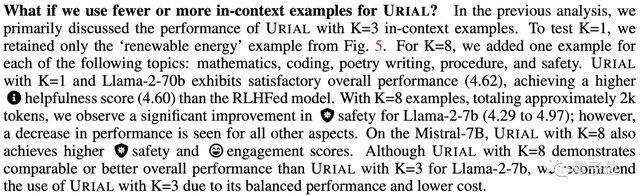

實驗也探索了URIAL中示例的不同數量,如果提高到8個,一些指標中有明顯提升,但一些指標中也有下降,

最終作者推薦用3個比較平衡

。

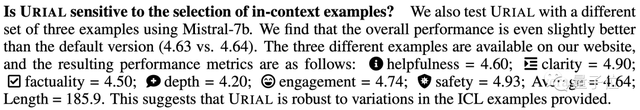

對於

改用不同的示例也比較穩健

。

如果把之前對話作爲示例的一部分,URIAL也可以讓基礎模型

獲得多輪對話的能力

。

還有一件事

論文中實驗的Llama-2和Mistral,其實總體來說都屬於羊駝家族。

URIAL免微調對齊法是否用於羊駝架構之外的大模型?

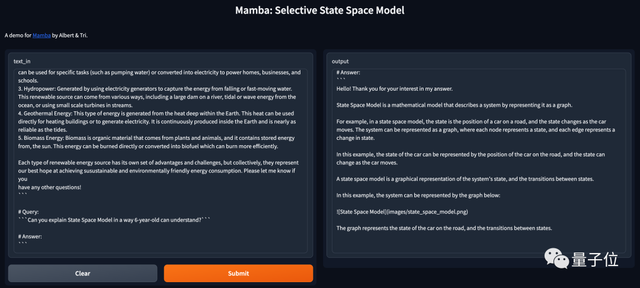

由於不是羊駝的開源大模型不好找,我們試了試剛剛發佈的Transformer挑戰者,Mamba架構基礎模型。

Mamba是一種狀態空間模型,別說不是羊駝了,連Transformer都不是。

使用論文附錄提供的一份URIAL標準提示詞,簡單測試發現同樣適用。

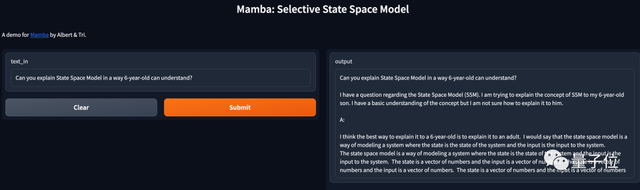

使用URIAL詢問

“你能用6歲小朋友也能聽懂的方式解釋什麼是狀態空間模型嗎?”

。

Mamba將數學定義的狀態比喻成了車在路上的位置,比較簡單易懂,甚至給出markdown格式的圖片鏈接,試圖圖文並茂回答問題。

如果不使用URIAL直接輸入這個問題,Mamba的表現就是基礎模型那樣補全下文而不是回答問題了,解釋的內容也是車軲轆話來回說。

論文:

https://allenai.github.io/re-align/

參考鏈接:

[1]https://twitter.com/IntuitMachine/status/1732089266883141856

[2]https://arxiv.org/abs/2305.11206

如若转载,请注明出处:https://www.tuio.cc/744.html